A Nvidia revelou o DGX Station, um supercomputador desktop projetado para executar modelos de IA de trilhões de parâmetros localmente, ignorando a necessidade de infraestrutura baseada em nuvem. Isto marca uma mudança significativa na computação pessoal, trazendo capacidades de IA anteriormente inacessíveis diretamente para desenvolvedores e empresas.

A ascensão da IA local

A Estação DGX aborda uma tensão crescente na indústria de IA: a demanda por modelos poderosos entra em conflito com o desejo de privacidade e controle de dados. Embora os modelos mais avançados ainda exijam data centers massivos, muitas organizações desejam manter seus dados, agentes e propriedade intelectual no local. A solução da Nvidia é uma máquina de seis dígitos que preenche a lacuna entre a IA de ponta e as estações de trabalho individuais.

Especificações Técnicas

A estação DGX é alimentada pelo GB300 Grace Blackwell Ultra Desktop Superchip, combinando uma CPU Grace de 72 núcleos com uma GPU Blackwell Ultra. Isso fornece 20 petaflops de desempenho computacional e 748 gigabytes de memória coerente. A interconexão NVLink-C2C oferece 1,8 terabytes por segundo de largura de banda, permitindo que CPU e GPU compartilhem memória sem gargalos de desempenho.

Esse nível de desempenho já foi exclusivo dos supercomputadores de ponta, como o sistema Summit do Laboratório Nacional de Oak Ridge, que exigia uma sala inteira para abrigar. A Nvidia agora oferece uma fração comparável dessa potência em uma unidade montável em mesa. Os 748 GB de memória unificada são cruciais para executar modelos de trilhões de parâmetros, eliminando as limitações impostas pela capacidade insuficiente de memória.

Agentes sempre ativos e o novo paradigma de IA

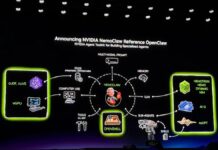

A Nvidia projetou a Estação DGX para a próxima onda de IA: agentes autônomos capazes de raciocínio, planejamento e execução contínuos. Esses agentes exigem computação, memória e estado persistentes, algo que uma GPU de nuvem alugada não pode fornecer de maneira confiável. A Estação DGX atende a essa necessidade com um tempo de execução seguro, NemoClaw, impondo proteções de segurança, rede e privacidade baseadas em políticas para agentes autônomos.

Escalabilidade perfeita

Uma das principais vantagens da Estação DGX é a sua continuidade arquitetônica. Os aplicativos construídos na máquina podem ser dimensionados perfeitamente para os sistemas de data center GB300 NVL72 da Nvidia sem reescrever o código. Isso elimina um grande custo oculto no desenvolvimento de IA: o tempo gasto na adaptação de modelos para diferentes configurações de hardware. O pipeline integrado verticalmente da Nvidia garante uma transição suave da prototipagem de desktop para a implantação em larga escala.

Adoção pelo mercado e implicações futuras

Os primeiros a adotar incluem Snowflake, EPRI, Medivis, Microsoft Research e Cornell, sinalizando os setores onde a IA está se integrando rapidamente às operações diárias. A estação DGX foi projetada para suportar uma ampla gama de modelos de código aberto, incluindo gpt-oss-120b da OpenAI, Google Gemma 3, Qwen3, Mistral Large 3, DeepSeek V3.2 e os próprios modelos Nemotron da Nvidia.

A estratégia mais ampla da Nvidia envolve possuir todas as camadas da pilha de IA, desde data centers orbitais até estações de trabalho desktop. A Estação DGX representa um passo fundamental nesta direção, expandindo o mercado endereçável da Nvidia e reforçando ao mesmo tempo o seu negócio na nuvem.

O futuro da computação de IA

A Estação DGX não elimina a nuvem; em vez disso, estabelece uma alternativa local confiável para cargas de trabalho onde o controle de dados e a operação contínua são fundamentais. Essa mudança significa que o trabalho sério de IA não exige mais o aluguel exclusivo de instâncias de GPU dos principais provedores de nuvem.

A chegada da Estação DGX marca uma nova era na infraestrutura de IA, colocando o poder genuíno da supercomputação diretamente nas mãos de desenvolvedores e organizações. O futuro da IA não se trata apenas de modelos maiores – trata-se de onde esses modelos funcionam e de quem os controla.