Amazon Web Services (AWS) uczestniczy obecnie w złożonej i ryzykownej grze. Inwestując znaczne środki zarówno w Anthropic, jak i OpenAI, gigant chmurowy zamierza zająć centralne miejsce w rewolucji sztucznej inteligencji – nawet jeśli oznacza to finansowanie dwóch zawziętych rywali jednocześnie.

Pokonywanie „konfliktów interesów”

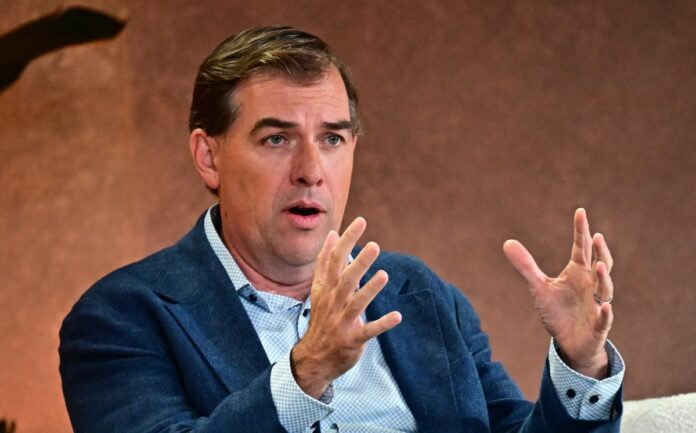

Na niedawnej konferencji HumanX w San Francisco dyrektor generalny AWS Matt Garman postawił najpilniejsze pytanie: w jaki sposób jedna firma może utrzymać zdrowe partnerstwo z dwiema organizacjami, które aktywnie walczą o dominację na rynku?

Garman twierdzi, że ten „konflikt” nie jest dla Amazona niczym nowym. Pracując w firmie od 2005 roku, zauważył, że AWS spędził prawie dwie dekady na budowaniu mięśni niezbędnych do współpracy i konkurowania z partnerami.

Strategia ta jest zakorzeniona w podstawowej rzeczywistości branży technologicznej: współzależności.

– AWS zapewnia infrastrukturę (chmurę) niezbędną do działania wielu firm zajmujących się oprogramowaniem.

– Jednocześnie AWS tworzy własne, autorskie narzędzia, które często konkurują z usługami tych samych partnerów.

Garman podkreślił, że pomimo rozwijania własnych produktów, firma zobowiązała się wobec partnerów, aby nie wykorzystywali jej platformy do zapewniania „nieuczciwej przewagi konkurencyjnej”.

Kwestia przetrwania w „wojnach w chmurach”

Decyzja o inwestycji w OpenAI – po ogromnej inwestycji o wartości 8 miliardów dolarów w Anthropic – to nie tylko dywersyfikacja portfela, ale strategiczna konieczność.

Przez większą część niedawnego boomu na sztuczną inteligencję modele OpenAI były dostępne głównie za pośrednictwem chmury Microsoft Azure. Dla AWS brak głębokiej relacji z OpenAI byłby katastrofalnym ciosem w udział w rynku. Inwestując, AWS gwarantuje, że będzie w stanie zaoferować swoim klientom najpotężniejsze modele, niezależnie od tego, kto je zbudował.

Trend w kierunku „nakładających się” inwestycji staje się nową normą w sektorze AI. Na przykład, gdy firma Anthropic zebrała fundusze w wysokości 30 miliardów dolarów, wielu jej zwolenników było również inwestorami w OpenAI – w tym Microsoft. W wyścigu o dominację sztucznej inteligencji tradycyjne pojęcie lojalności inwestorów ustępuje miejsca pragmatycznemu pragnieniu posiadania udziałów w każdej zwycięskiej technologii.

Przyszłość: model routingu i ekosystemy hybrydowe

W miarę rozwoju branży walka przesuwa się z płaszczyzny „który model jest lepszy” na płaszczyznę „jak te modele są wykorzystywane”. Garman wskazał na przyszłość zdefiniowaną przez usługi routingu modelu AI.

Zamiast polegać wyłącznie na sztucznej inteligencji, firmy prawdopodobnie użyją wyrafinowanej warstwy orkiestracji, która rozdziela zadania między różne modele w oparciu o wydajność:

– Modele o wysokim poziomie rozumowania – do kompleksowego planowania strategicznego.

– Modele specjalistyczne – do głębokich obliczeń naukowych lub matematycznych.

– Lekkie i tanie modele – do prostych zadań, takich jak uzupełnianie kodu lub generowanie podstawowego tekstu.

Dzięki temu podejściu „routingowemu” dostawcy usług w chmurze pozostają niezbędni. Daje także AWS i Microsoft subtelny sposób na integrację własnych modeli sztucznej inteligencji z przepływem pracy, jednocześnie cicho konkurując z zewnętrznymi dostawcami pod pozorem optymalizacji wydajności i kosztów.

Krajobraz sztucznej inteligencji zmierza w stronę ekosystemu hybrydowego, w którym dostawcy usług w chmurze działają zarówno jako właściciel, jak i konkurent, zarządzając wieloma różnymi modelami, aby sprostać zmieniającym się wymaganiom konsumentów.

Wniosek

AWS przyjmuje wyrafinowaną strategię współpracy z wieloma partnerami, aby zapewnić sobie rolę podstawowej platformy w erze sztucznej inteligencji. Inwestując we wszystkich kluczowych graczy, Amazon stawia dominację infrastrukturalną ponad tradycyjnymi granicami konkurencji.