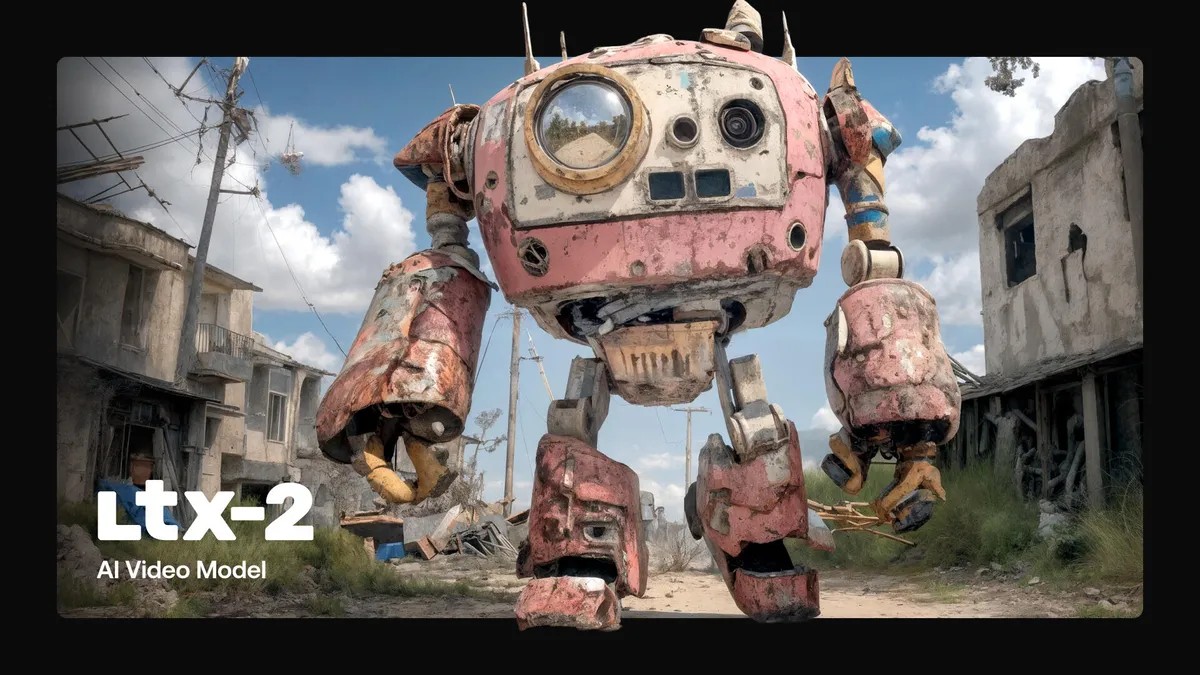

Lightricks a dévoilé un nouveau modèle vidéo d’IA, construit en partenariat avec Nvidia, qui se démarque en s’exécutant directement sur les appareils des utilisateurs au lieu de s’appuyer sur le traitement cloud. Cela marque une avancée significative dans la génération de vidéos IA, offrant à la fois une confidentialité améliorée et des performances plus rapides. Le modèle, présenté au CES 2026, est conçu pour les créateurs professionnels et offre des capacités dépassant de nombreux concurrents en termes de contrôle et de qualité de sortie.

Capacités et fonctionnalités clés

Le modèle Lightricks peut générer des clips vidéo IA d’une durée maximale de 20 secondes à 50 images par seconde, y compris l’audio natif. Surtout, il prend en charge la résolution 4K, ce qui le rend viable pour les projets professionnels. Contrairement au Veo 3 de Google ou au Sora d’OpenAI, l’optimisation sur l’appareil de ce modèle est sa caractéristique déterminante. L’accent est mis sur l’offre aux créateurs d’un flux de travail sécurisé et efficace.

Que signifie « poids ouvert »

Le terme « ouvert » dans l’IA fait souvent référence à des modèles « ouverts », ce qui signifie que les développeurs peuvent accéder aux éléments constitutifs de l’IA mais pas nécessairement au code source complet et totalement transparent. Pensez-y comme si vous aviez une recette de gâteau : vous connaissez les ingrédients, mais pas les mesures précises. Le modèle de Lightricks est disponible sur des plateformes telles que HuggingFace et ComfyUI, permettant une expérimentation et une personnalisation plus larges.

Pourquoi le traitement local est important

La génération de vidéos IA nécessite beaucoup de calculs. La plupart des modèles nécessitent des ordinateurs de centre de données puissants pour produire des résultats de haute qualité, obligeant les utilisateurs à s’appuyer sur les services cloud. Le modèle de Lightricks, exploitant les puces RTX de Nvidia, rompt cette dépendance. Exécuter l’IA localement présente plusieurs avantages :

- Contrôle des données : les créateurs conservent un contrôle total sur leurs données, évitant ainsi toute utilisation abusive par les grandes entreprises technologiques. Ceci est particulièrement critique pour les studios qui protègent la propriété intellectuelle.

- Vitesse : Le traitement local peut réduire considérablement les temps de génération. Les invites vidéo IA typiques prennent 1 à 2 minutes ; un délai d’exécution plus rapide signifie des économies de temps et d’argent.

- Sécurité : L’exécution sur l’appareil minimise le risque de violation de données ou d’accès non autorisé à du contenu sensible.

Exécuter des modèles d’IA sur votre appareil, avec l’équipement approprié, peut également vous donner des résultats plus rapidement. La génération moyenne d’une invite vidéo IA prend 1 à 2 minutes, donc la réduire pourrait permettre d’économiser du temps et de l’argent, qui sont deux des arguments les plus solides pour les créateurs intégrant l’IA dans leur travail.

L’essor du traitement vidéo local par IA est une progression naturelle, à mesure que la puissance de calcul devient plus accessible. Cette tendance suggère une évolution vers une plus grande indépendance des créateurs et un écosystème d’IA plus sécurisé.